近期,一款名为Vidu1.5的视频生成模型受到了广泛关注。该模型由生数科技与清华大学合作研发,宣称具备多主体一致性处理的新功能,这一特点颇具吸引力。用户能够上传多张图片,从而生成视频,这一功能在当前视频模型领域中成为了一个新的研究热点。

多主体一致性新功能

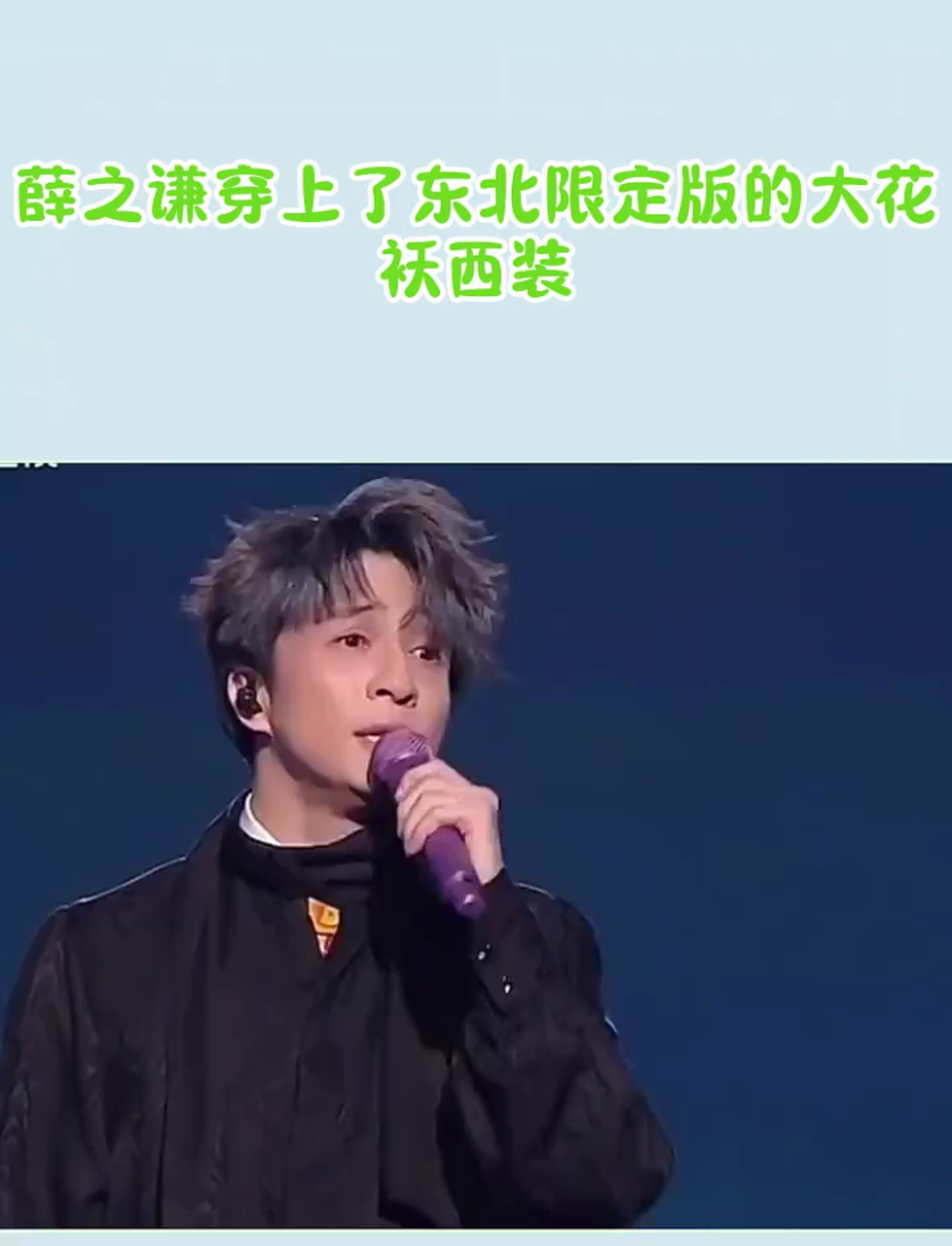

过往的AI视频制作主要依赖单一语句或静态图像来激发AI的创作,如将马斯克形象进行创意改造,传统方法往往难以实现。然而,Vidu1.5的更新使得这一挑战得以克服。用户只需上传马斯克的照片、花袄图片以及白宫相关素材,并给出简短的提示,便能够生成极具欺骗性的视频内容。这一创新功能赋予了我们手动操控AI素材的能力,从而丰富了视频的多样性。

Vidu1.5的这项功能突破,对广大用户及创意人士而言,无疑是个喜讯。用户无需再费尽心思构思提示词,只需上传图片,即可轻松获得期望的视频效果。此举显著提升了创作效率,同时也极大地丰富了创作选择。

实际测试例子多

在测试环节,更换人物照片制作视频的效果表现良好。例如,使用乔布斯的大头照,即便只有正脸,也能精确地还原其侧面的人物特征。此外,还可以利用唐伯虎点秋香的图像进行脸部替换等操作。

测试过程中亦显现出若干问题。虽然能够捕捉主体,但在场景变化频繁或动作幅度较大时,往往会出现小错误。以塑胶胖虎生成的视频为例,胖虎的动作显得不够流畅。在雷军的测试中,同样出现了面部变形以及人物掉出车外的现象。

与大语言模型技术类似

Vidu的新模型借鉴了大语言模型的技术路径,将所有输入信息转化为视觉数据。它具备类似大语言模型的“上下文记忆”功能,能够对输入数据进行处理。这种处理模式具有独特之处,同时也引发了新的思考和研究趋势。

这反映出其在技术融合领域进行了尝试,但现阶段这种尝试尚处于起步阶段。通过实际测试结果可见,视频的转换与生成效果尚不稳定,尚未达到成熟水平。

视频效果时好时坏

在下午的测试过程中,Vidu1.5的表现呈现出不稳定的状态。它有时能够将冰雪女王的动作与场景的连贯性处理得相当出色,几乎可以达到以假乱真的效果。然而,也有时候会出现类似于雷军测试时所遇到的画面崩坏问题。

创作过程中,这种不稳定性显得尤为棘手,对于追求稳定创作成果的用户而言,显得不够友好。它暗示了用户可能需要经过多次尝试,才能达到令人满意的效果。

使用建议需遵循

若计划体验Vidu1.5模型,需留意以下几点。首先,上传主体照片时,请确保背景简洁。此外,提供多角度的同一主体照片,将有助于使主体在视频中动作显得更为自然。

这些建议有助于提升用户制作高质量视频的成功率。然而,这也反映出模型本身存在一定的局限性,用户需借助特定技巧来加以克服。

仍有很长路要走

经过初步测试,该模型展现出一些颇具创意的观点,但在细节处理上尚显不足,整体表现亦不够稳定。目前,其距离全面取代视频制作人员的工作仍有一段距离。

尽管技术已获得新功能,但其成熟度仍需显著提高。因此,在接触此模型时,请勿抱有过高期望,尚有许多方面有待完善和改进。

鉴于Vidu1.5视频模型具备诸多优势与不足,公众普遍认为其未来最迫切的改进方向为何?我们诚挚邀请广大用户在评论区留言交流。此外,若您认为本文对您有所帮助,敬请点赞并分享。