帕西菲克帕利塞兹社区及阿尔塔迪纳地区的野火已完全失去控制。据1月10日的快科技报道,现场已有超过1500名消防员投入救援。干燥和强风条件加剧了火势的扩散。与此同时,这一事件引起了广泛关注,但网络上也出现了虚假信息。

好莱坞标志牌着火图是假的

网络上出现了一张好莱坞标志牌起火的图片和视频,众多媒体纷纷转发,误以为标志牌真的发生了火灾。然而,仔细观察可以发现,这张图片存在明显瑕疵,标志牌上多出了一个字母,变成了“HOLLYWOODD”,并且在右下角还发现了“Grok AI”的水印,表明这是由xAI公司开发的人工智能工具所生成的。

X平台强调,相关内容系AI生成,旨在误导公众。鉴此,信息传播过程中需格外注重核实信息的真实性。

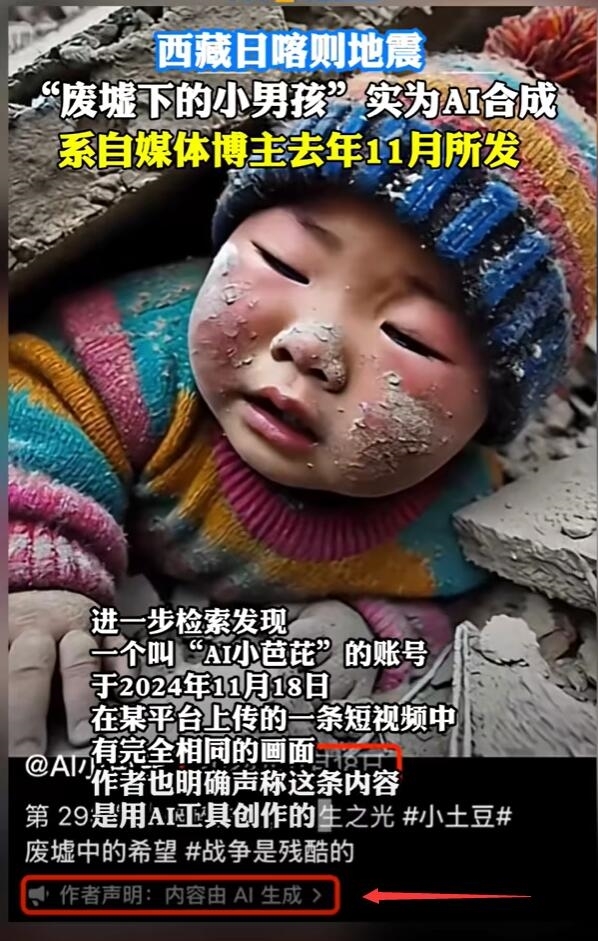

西藏地震AI假图事件

并非仅有,在西藏发生地震之际,AI生成的图片亦在网络上流传。其中一张描绘儿童被埋的图像引起了广泛关注。然而,这幅图像实为去年由AI作者创作,并非地震现场的真实记录。这一现象表明,在灾难事件的报道中,AI伪造内容的问题同样存在。

这两个案例揭示了提升对AI生成虚假图像辨识技能的必要性,我们不应轻信网络传播的所谓灾区等关键时期的图片。

识别AI假图的方法

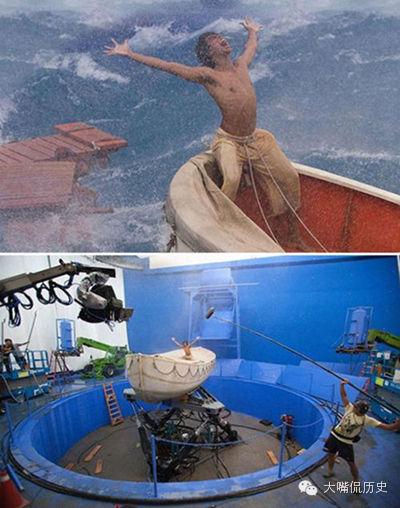

官方指出,识别AI生成假图的方法包括:首先,对疑似图片进行细节观察。通常,AI生成的图像中人物表情显得生硬。

画面边缘可能变得不清晰,光与影的分布显得不协调,甚至可能出现手指等细节过多或变形的情况。这些现象为公众提供了一些基本的识别方法。

获取信息应多渠道查证

在接触信息时,公众不宜仅凭单一图片或视频便断定事件的真实性。他们应当通过多个官方渠道搜集信息,并对比分析,以判断信息来源的可靠性。

当前网络高度发达,AI技术造假现象普遍,若不经核实便随意传播信息,极有可能成为虚假信息的传播者,从而对社会及他人造成损害。

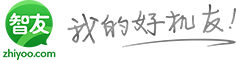

AI发展带来的风险

当前人工智能技术发展迅猛,相关假图事件提醒我们需警惕AI潜在风险。不良分子可能利用AI技术制造虚假信息。这种现象不仅出现在火灾、地震等突发事件中,在其他新闻事件中也可能出现。

人工智能技术的广泛应用预示着内容产量的显著增加,若缺乏有效管理,虚假信息的传播将难以遏制。

规范AI用途的必要性

AI应用需遵循规范,例如,在生成图像时嵌入不易察觉的水印,以助公众识别。AI不应沦为散播虚假信息的工具。唯有对AI的使用进行规范,方可有效防止类似事件中虚假信息的进一步扩散。

通过确保信息获取与传播的安全,公众能够享有更安心的体验,同时社会舆论环境亦能维持其健康状态。在信息获取过程中,读者们是否对信息的真伪进行了细致的辨别?