当前,随着科技的迅猛进步和人工智能的持续创新,开源技术的最新动态常受到公众的高度关注。2月25日,在深度学习领域,快科技发布了一则报道,指出DeepSeek开源周的第二天,推出了开源代码库DeepEP,这一消息如同重磅炸弹,其具体能力如何,值得我们深入探究。

开源周新亮点

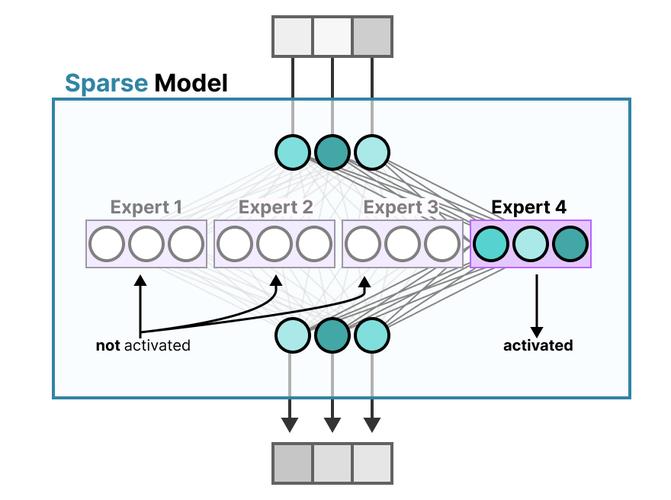

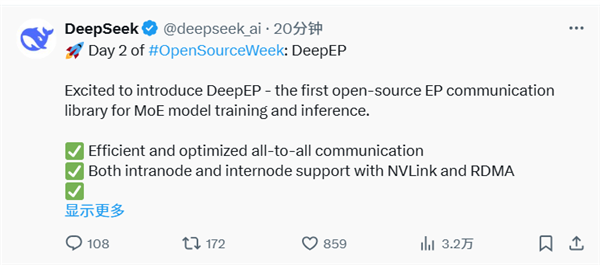

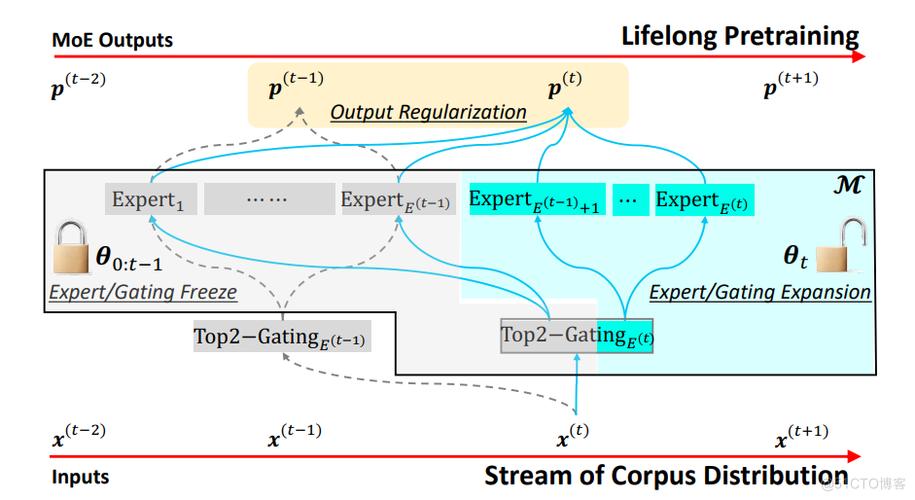

2月25日,DeepSeek开源周的第二天,DeepSeek如期发布了开源代码库DeepEP。这一举动迅速在业界引起了广泛关注,为追求技术突破的AI开发者和科研人员注入了新的希望。DeepEP成为首个专门用于MoE模型训练与推理的开源EP通信库,其问世标志着MoE模型专用通信工具领域的空白得到填补,具有划时代的意义。

通信架构优势

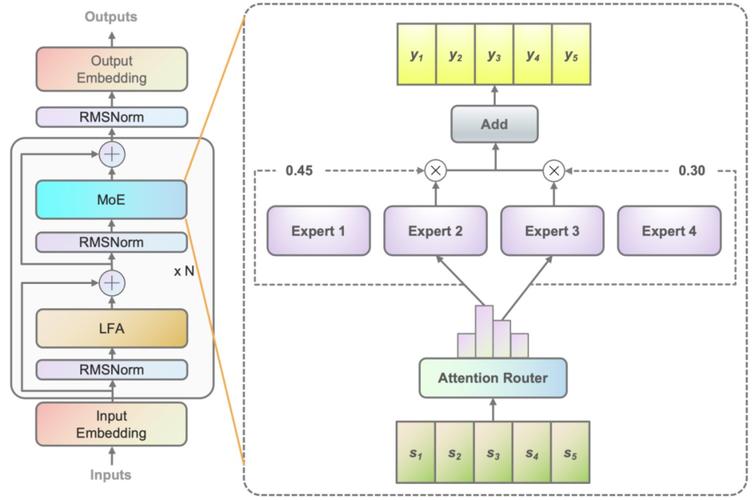

DeepEP运用了一种高效的通信结构。该架构实现了优化的端到端通信方式。通过节点内部以及节点间的NVLink与RDMA连接,显著提高了数据传输的效率。数据传输环节变得更为流畅,原本复杂且耗时的问题得到解决。这一变化显著提升了大规模分布式AI的训练速度和实时推理效率。数据传递速度加快,确保了数据能迅速抵达目的地,从而为模型训练和推理提供了稳固的通信支持。

精度运算优化

DeepEP以多精度计算和调度优化为显著特点。其原生具备对FP8低精度运算的调度支持,这一功能显著减少了计算资源的消耗。在人工智能计算领域,资源的有效利用至关重要。DeepEP通过此技术创新,实现了计算资源的合理分配。开发者在使用过程中,能够在确保精度要求的前提下,降低不必要的资源占用,从而提高整体效率和性能。

高性能内核能力

该高性能核心由高吞吐量核心和低延迟核心构成。高吞吐量核心特别适用于训练和预推理任务,有效利用硬件计算资源,显著提升数据处理效率,大幅减少训练所需时间。低延迟内核专门为推理解码环节进行了优化设计,运用了纯RDMA通信以及自适应路由技术。这些技术的应用显著降低了数据传输及处理过程中的延迟。因此,模型得以加速输出结果,满足了那些对实时性要求较高的应用场景的需求。

资源控制机制

DeepEP系统拥有资源管理和重叠处理功能。它采用灵活的GPU资源管理策略,有效实现了计算与数据传输的高效结合,减少了资源闲置和浪费现象。具体来说,在GPU执行计算任务的同时,数据传输同步进行,确保了系统在不额外增加硬件投入的情况下,提高了工作效率,并实现了资源的最佳分配。

深度优化场景

DeepEP具备对NVLink至RDMA非对称带宽转发场景进行特定优化的功能。随着异构网络环境的日益普及,传统通信库在此类场景中可能无法达到理想效果。DeepEP通过实施专项优化措施,有效增强了异构网络环境中的传输效率。此外,该系统具备对SM数量的动态调整功能。它能依据不同任务的具体需求,例如训练或推理,自动调节吞吐量,从而使系统在智能性和灵活性方面得到提升。

当前,随着人工智能技术的持续进步,诸如DeepEP的开源代码库为业界带来了新的活力。关于DeepEP在人工智能未来发展趋势中的潜在作用,您有何见解?欢迎在评论区留下您的观点。同时,请不要忘记为本文点赞及转发。