大模型本地部署热潮

近期,DeepSeek等高性能开源模型的新发布,引发了众多政府及企业机构在本区域推广私有化人工智能服务的趋势。这一趋势主要因对数据安全与自主控制的强烈需求所驱动,并且也体现了企业期望通过本地部署提升工作效率的意愿。但值得注意的是,大规模的本地部署方式同样伴随着潜在的安全隐患。

企业在享受大模型带来的便利时,亦需应对技术安全等更多挑战。众多政府与企业竞相涉足此领域,这一现象充分反映了大模型在当地所展现出的显著吸引力及深远影响。

Ollama工具的应用

Ollama凭借其操作简便性,在大型模型的获取与运行领域颇受欢迎。该平台支持DeepSeek、Qwen等众多前沿语言模型,并支持用户在服务器上执行这些模型。通过提供便捷服务及多样化的模型选择,Ollama显著降低了企业使用大型模型的门槛,为政府及企业使用高性能模型技术提供了更多可能性。

尽管Ollama的广泛应用为人们带来了诸多便利,然而它同时也引发了一系列安全问题。这些问题亟待所有使用该工具的政府和企业机构给予高度重视。

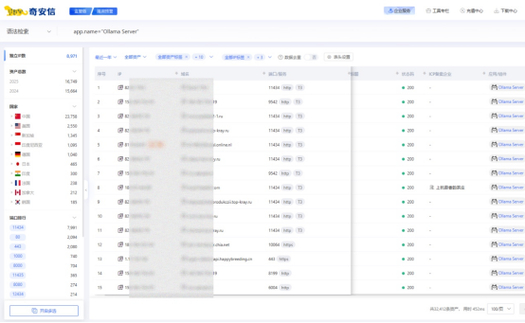

安全防护现状堪忧

监测数据显示,在采用Ollama大模型框架的8971台服务器中,有6449台处于活跃状态。然而,令人关注的是,其中88.9%的服务器未能实施有效的安全保护措施,暴露在互联网上。这些未配备安全防护的服务器宛如无人守护的宝藏,任何人都能未经许可随意访问。

该行为提高了服务被过度使用的风险,可能导致数据泄露及服务中断,对政府和企业机构的运营及信息安全造成重大威胁,当前形势紧迫且严峻。

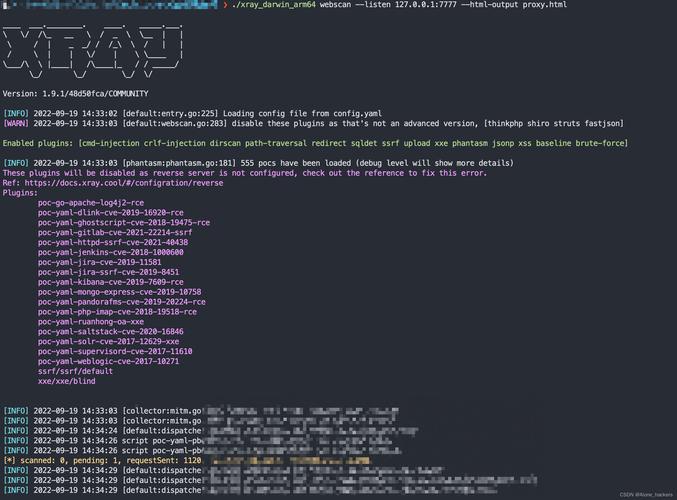

严重安全事件频发

状况加剧,服务器安全防护薄弱,导致攻击者得手,成功下达指令删除已部署的大型模型文件,进一步加剧了系统安全风险。已有案例表明,攻击者运用自动化脚本对未采取防护措施的DeepSeek服务器进行扫描。他们恶意消耗大量计算资源,窃取算力,致使部分用户的服务器发生崩溃。

政企单位需警惕此类事件,它们突显了提升大型模型安全防护的迫切需求。稍有疏忽,可能招致严重后果。

专家提出防护建议

360织语的产品专家强调,在私有化部署大型模型时,政府和企业机构必须关注人工智能领域面临的安全难题,并确保模型在运行全过程中享有安全防护。具体措施有:及时执行相关策略,建立身份认证体系,优化防火墙及入侵检测等安全配置,比如设定IP白名单来限制访问权限。

在确保遵守安全标准的前提下,政企在引入模型前需进行周密的安全审查,并实施相应的安全措施,从而确保大规模模型应用的安全性得到全方位的保障。

360解决方案登场

针对用户对大型模型在安全性和深度应用方面的需求,360织语借助360大模型训练推广平台,推出了“DeepSeek大模型一体机”解决方案。该方案涵盖了从基础计算能力到模型服务、训练功能和应用开发的全方位内容。

政企可以利用此技术打造“数据边界清晰、性能更优”的AI服务新形态,这有助于解决大模型应用过程中的安全与效率难题,进而为企业的数字化转型提供稳固的保障。

请问政府及企业能否快速并有效地实施这些安全措施,以保障大型模型的安全应用?敬请于评论区分享您的见解。此外,敬请别忘了为本文点赞及分享!