科研新突破

近期,摩尔线程研究团队公布了一项新成果——《Round Attention:基于轮次块稀疏性的创新多轮对话优化方法》,这标志着多轮对话优化领域的一项重要突破。尽管人工智能大型语言模型促进了语言服务的广泛应用,但在长时间交流过程中,仍存在不少问题。这项成果的及时推出,旨在应对这些挑战。

在现有技术背景下,增强多轮对话功能遭遇了众多难题。摩尔线程近期的研究进展为业界注入了新思路,预示着多轮对话技术可能迎来新的成长机遇。

应用背景现状

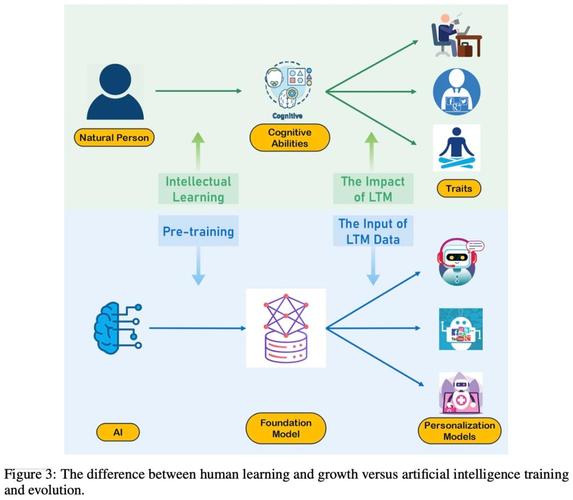

人工智能大型语言模型不断取得进展,其在解决日常问题等任务中的应用范围正逐步拓宽。智能客服、智能助手等领域纷纷利用这些模型,以提供更加高效的服务。

在长期的交流互动中,语境的长度大幅增加,这给自注意力机制带来了极大的计算负担。尽管键值缓存技术能在一定程度上减轻计算上的冗余,但它同时也增加了对GPU内存的依赖。这种变化限制了推理批处理的能力,降低了GPU的工作效率,进而影响了多轮对话的流畅度和效率。

问题应对策略

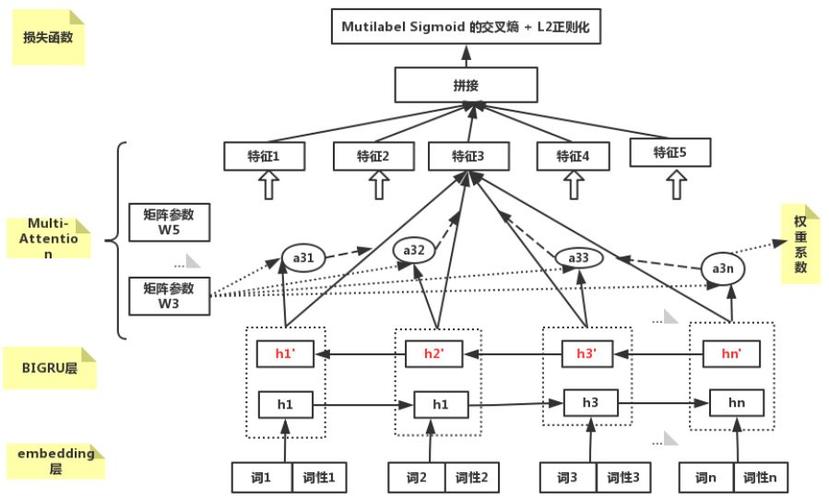

摩尔线程针对这些问题,创新性地提出了名为 Round Attention 的技术方案。该技术以轮次作为基本分析单元,专注于探究 Attention 的运作原理。这种独特的分析角度,有助于更深入地揭示多轮对话中 Attention 的本质特征。

研究揭示了轮次粒度注意力分配的规律,这一发现为深入研究提供了坚实基础。同时,它增强了优化策略的精确性。此外,该规律有望在根本问题上解决多轮对话中的计算和显存难题。

创新设计思路

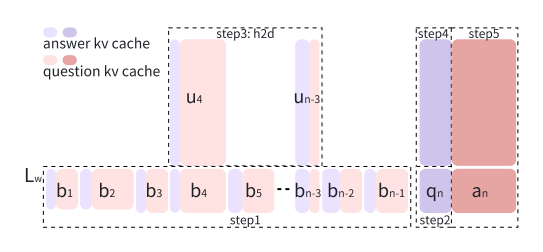

Round Attention 是为多轮对话场景下的推理需求所设计,它依据对话轮次来界定 KV 缓存的边界。研究团队揭示了轮次级 Attention 分布的两大关键规律,这些规律成为了研究的主要成果。

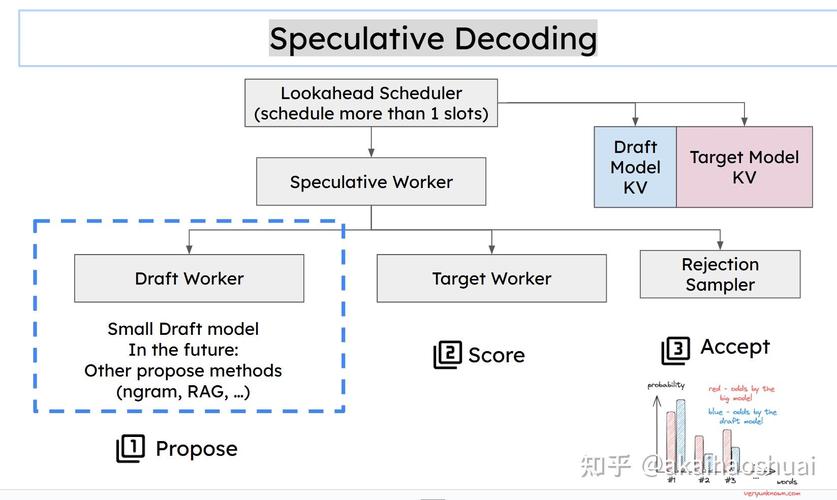

在此背景下,提出了Round Attention这一推理机制。该机制将稀疏性从Token层提升至Block层。在此流程中,优先对与任务高度相关的Block执行attention计算,以此减少计算所需时间。此外,将无关的Block转移到CPU内存,有效减少了显存的使用。

核心优势亮点

摩尔线程指出,轮次块稀疏性具备三个显著优势。首先,其自然边界确保了在数据处理过程中不会遗漏关键语义信息。其次,这一特性有助于维护推理的精确度和准确性。

分水岭层的注意力稳定性确保了系统在多轮对话中保持稳定,此外,端到端的存储与传输优化策略显著增强了整体性能。这些策略减少了存储和传输过程中的冗余,从而提升了工作效率。

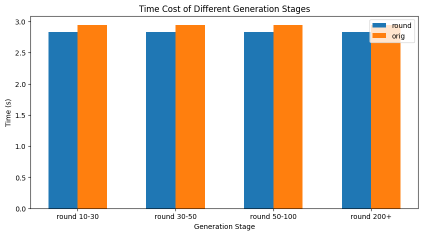

测试效果验证

测试结果显示,Round Attention 的端到端延迟较Flash Attention推理引擎有所减少。同时,kv-cache的显存消耗量减少了55%至82%。这些数据充分表明,该成果在性能提升方面取得了显著成效。

在主观与客观评估数据集的测试中,模型的推理精度保持稳定。这一发现表明,在性能提升的过程中,推理效果并未显著下降。这一成果为多轮对话在实际应用中的质量提供了稳固的保障。

您如何看待摩尔线程的研究动态?这一进展可能对多轮对话技术的未来发展产生哪些重要影响?