无需高端显卡也能在本地运行大型模型?这一观点对传统认知提出了挑战。当前,我们一同揭开轻薄笔记本电脑上部署大型模型的秘密。

Deepseek 大模型出圈自Deepseek大模型问世后,其卓越性能和开源特性使其迅速获得广泛关注,成为当前备受关注的AI大模型之一。Deepseek-R1模型参数量高达671亿,模型公开的同时,还提供了六个不同规模的精简版本。这一系列丰富多样的选择,使得用户可根据自身设备条件,挑选最适宜的模型进行本地部署。

本地部署原因众多企业竞相推出人工智能服务,在此背景下,在本地部署大型模型显得尤为关键。一方面,这有助于避免云服务的波动,比如Deepseek在初期就曾遇到网络故障。另一方面,考虑到部分数据不宜公开或上传至云端,本地处理成为确保数据与隐私安全的关键措施。此外,新型硬件展现了卓越的计算性能,用户普遍希望最大化这一优势。同时,该硬件自身亦具备支撑大型模型本地执行的能力。

部署变得容易目前,本地部署大型模型任务已不再复杂。网络资源提供了详尽的部署指南和策略,还有便捷的一键安装包。用户仅需下载、解压并运行,即可轻松启动AI大模型在本地。此变化显著简化了本地部署过程。

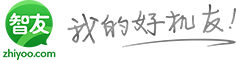

显卡依赖问题传统教程普遍强调,操作大型模型需要较高的本地计算能力,这通常需要依赖性能强劲的显卡。在决定模型大小的时候,显存的大小变得尤为关键。但这一条件对于没有独立显卡的轻薄型笔记本来说并不友好,这可能导致许多用户因条件限制而选择不在本地部署模型。

无显卡新尝试研究人员对低显存显卡支持大型模型部署的能力进行了验证,为此选用了装备Intel酷睿Ultra 9 285H处理器的便携笔记本进行测试。测试目的是充分发挥CPU、集成显卡和神经处理单元的计算能力,从而实现本地人工智能大型模型的应用。

未来应用展望若此次尝试得以顺利实现,其带来的影响将极为深远。这一成就将拓宽大模型的应用领域,让更多设备具备运行大模型的能力。在教育领域,学生可借助便携式笔记本电脑部署大模型以辅助学习;在办公场景中,普通员工也能在不配备显卡的设备上使用大模型提高工作效率。面向未来,这种无需显卡的部署方式有望得到更广泛的推广。

关于未来大型模型无需依赖显卡的部署走向,您有何看法?敬请于评论区分享您的观点。此外,还请别忘了为本文点赞并予以转发。